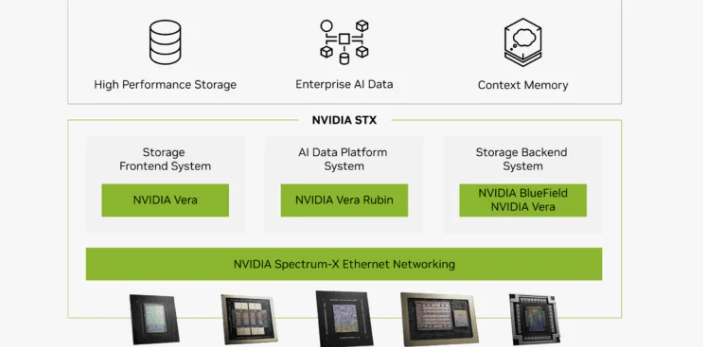

NVIDIA ha presentado en Estados Unidos la nueva arquitectura de pipeline de datos BlueField-4 STX, centrada en la plataforma BlueField-4 DPU, diseñada para abordar la ineficiencia en el movimiento de datos entre almacenamiento, memoria y GPU en sistemas de IA a gran escala.

La arquitectura BlueField-4 STX integra estrechamente las operaciones de almacenamiento, red y memoria con el cómputo de GPU para acelerar el acceso a datos en cargas de trabajo de inferencia y agentes de IA. En lugar de depender de las rutas de datos tradicionales basadas en el host, aprovecha las DPU para descargar y orquestar directamente el movimiento de datos, entregando así más rápido los pesos del modelo, el contexto y los datos de caché clave-valor a la GPU.

A medida que la infraestructura de IA se expande desde el entrenamiento hasta la inferencia a gran escala, las cargas de trabajo están dominadas por patrones de acceso a memoria, expansión de contexto y generación de tokens, más que por el cómputo bruto. En estos escenarios, las GPU a menudo no se utilizan plenamente debido a retrasos en la entrega de datos, especialmente al procesar modelos de lenguaje grandes que requieren acceso rápido a conjuntos de datos distribuidos y pools de memoria.

La arquitectura BlueField-4 STX de NVIDIA reduce la latencia, aumenta el rendimiento y mejora la utilización de las GPU en los clústeres de IA al combinar redes de alta velocidad, acceso directo NVMe y orquestación de datos con conciencia de memoria dentro de la DPU. La plataforma también admite servicios avanzados de datos como prefetch, caché y colocación directa de datos, cruciales para flujos de trabajo de inferencia de múltiples pasos y agentes.

Este anuncio se alinea con el esfuerzo de NVIDIA por definir la "fábrica de IA" como un sistema completamente integrado, donde cómputo, red, almacenamiento y software se co-diseñan para maximizar el rendimiento. La DPU juega un papel central en este modelo como punto de control para el movimiento de datos, la seguridad y la descarga de infraestructura.

NVIDIA lanza la arquitectura BlueField-4 STX para optimizar los pipelines de datos de IA, con el objetivo de acelerar las cargas de trabajo de inferencia y agentes de IA. Utiliza DPU para descargar y orquestar el movimiento de datos desde la CPU, integrando redes de alta velocidad, acceso a almacenamiento NVMe y operaciones con conciencia de memoria, mejorando la utilización de GPU al reducir cuellos de botella en la entrega de datos, y admitiendo servicios avanzados de datos como caché, prefetch y colocación directa.

Este anuncio subraya un cambio en las prioridades de diseño de la infraestructura de IA. Antes, la industria se centraba en el rendimiento de la GPU y el ancho de banda de interconexión, pero a medida que los modelos crecen y las cargas de trabajo de inferencia se vuelven más complejas, la velocidad de entrega de datos se convierte en un factor limitante. En muchos despliegues, las GPU a menudo permanecen inactivas esperando datos, una ineficiencia más evidente en flujos de trabajo que requieren acceso frecuente a fuentes de datos distribuidas.

Al trasladar la orquestación de datos a la capa DPU, NVIDIA reposiciona el pipeline de datos como un componente crítico de la infraestructura de IA. Esto exige a los proveedores de infraestructura de IA no solo abordar el rendimiento de cómputo, sino también gestionar eficientemente el movimiento de datos en el sistema. El lanzamiento de BlueField-4 STX refuerza la importancia de la DPU como punto de control estratégico, evolucionando hacia un procesador de infraestructura que maneja acceso al almacenamiento, ejecución segura y orquestación de cargas de trabajo, convirtiéndose en una capa central para los centros de datos de IA de próxima generación.

De cara al futuro, el panorama competitivo podría expandirse hacia arquitecturas de pipeline de datos, jerarquías de memoria e integración de almacenamiento. La iniciativa de NVIDIA sugiere que la próxima fase de innovación en infraestructura de IA estará definida por cómo los sistemas entregan datos a los motores de cómputo.