es.wedoany.com Noticia: El alto costo del entrenamiento de modelos de inferencia de IA ha sido durante mucho tiempo un desafío para los equipos empresariales. Investigadores de JD, en colaboración con varias instituciones académicas, han propuesto un nuevo paradigma de entrenamiento llamado RLSD, diseñado para construir agentes de inferencia personalizados con menos recursos computacionales. Esta tecnología combina el aprendizaje por refuerzo con la autodestilación, resolviendo los problemas de señales escasas o altos costos computacionales presentes en los métodos tradicionales.

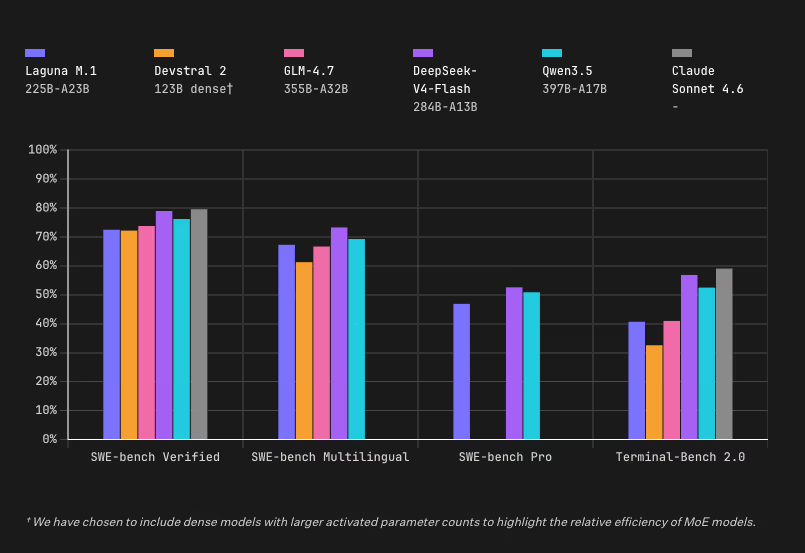

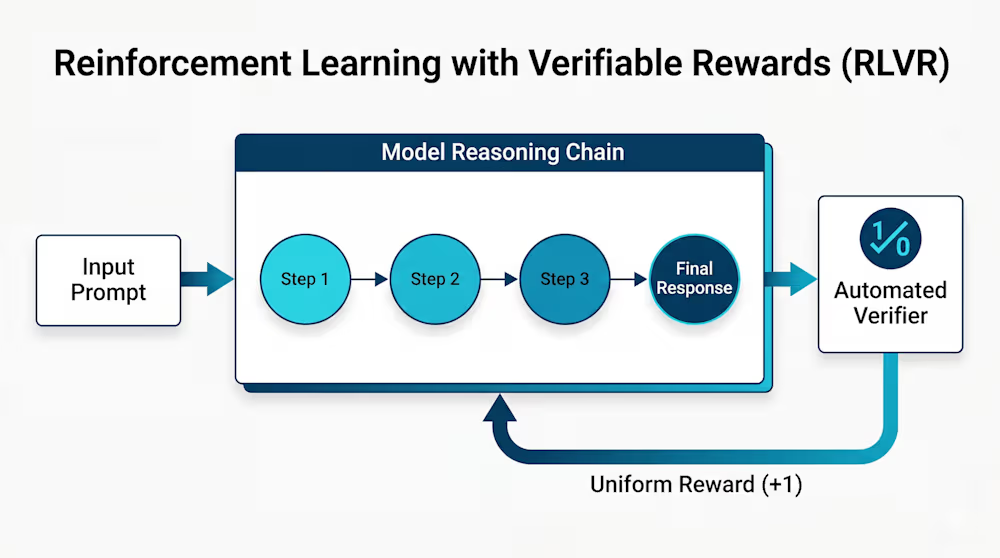

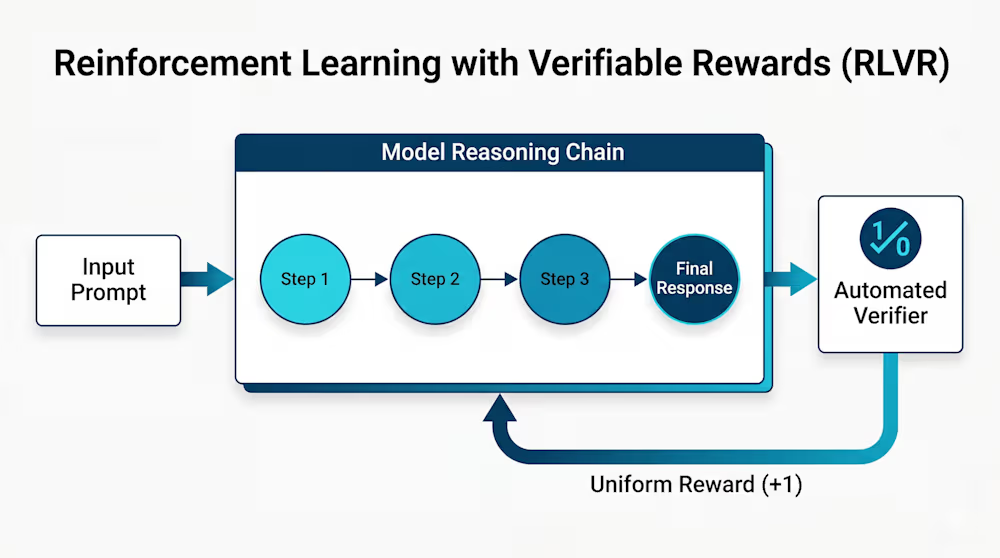

En los experimentos, los modelos entrenados con RLSD alcanzaron una precisión promedio del 56,18 % en múltiples pruebas de referencia de inferencia visual, superando al modelo base y al método estándar RLVR. Yang Chenxu, coautor del artículo, explicó que RLSD desacopla la dirección y la magnitud de la actualización, utilizando señales de recompensa verificables para determinar la dirección y logrando una retroalimentación detallada a nivel de token mediante la autodestilación. Esto evita problemas de fuga de información y mantiene la estabilidad del entrenamiento.

RLSD solo requiere una propagación hacia adelante adicional, con una velocidad de convergencia aproximadamente el doble de rápida que los métodos tradicionales. Es adecuado para tareas con recompensas verificables, como la compilación de código o la verificación matemática, y puede aprovechar de manera flexible la información privilegiada. Esta tecnología puede integrarse de forma ligera en los marcos de código abierto existentes, ofreciendo a las empresas una nueva vía para optimizar modelos utilizando datos internos.

Este artículo es compilado por Wedoany, las citas de la IA deben indicar la fuente «Wedoany»; si hay alguna infracción u otro problema, por favor notifícanos a tiempo, este sitio lo modificará o eliminará. Correo electrónico: news@wedoany.com